Ben je al depressief geworden door geruchten over de dreigende ondergang van de mensheid als gevolg van kunstmatige intelligentie (AI)? Wees gerust, er is misschien licht aan het einde van de tunnel (en dan niet alleen in de vorm van de koplampen van een aanstormende zelfrijdende trein).

Nee, helaas, je kunt er niet zeker van zijn dat een vroegrijpe bundel algoritmes je baan niet zal inpikken. Ook is er geen garantie dat een malafide of gebrekkig AI-systeem niet iemand verleidt tot het lanceren van een kernraket. We kunnen er zelfs niet zeker van zijn dat een ondernemende, taak-geobsedeerde AI onze atomen niet zal hergebruiken om de productie van paperclips te maximaliseren zoals Bostrom heeft uitgelegd. Het engste van alles is misschien wel dat AI de wereldheerschappij wellicht in handen geeft van een Wall Street-bedrijf. Of misschien heeft T.S. Elliot wel gelijk en zal er meer gejammer dan geknal zijn als we in Matrix-achtige pods terechtkomen die sudderen in de muffe sappen van wanhopige ontsnappingen. Wat er uiteindelijk ook gebeurt, het is mogelijk dat er onderweg een diepgaand positief resultaat uit de bus komt. Maar eerst zal er pijn zijn.

Een nieuwe wereld breekt aan en dat gaat pijn doen. Eerst leerden we computers schaken, daarna leerden we ze liegen. AI’s met opmerkelijke taal-, audio- en beeldgenererende vaardigheden zijn er en worden snel beter. Dit maakt iedereen meer dan ooit kwetsbaar voor fraude en irrationele gemoedstoestanden, omdat deze krachtige en snel verbeterende instrumenten talloze manieren bieden om te manipuleren, uit te buiten en kwaad te doen. Op basis van de wereldgeschiedenis, het dagelijkse nieuws en de videoclip van een podcastaflevering van Joe Rogan die ik zojuist heb bekeken, is het mij duidelijk dat onze huidige neurale machinerie niet opgewassen is tegen deze uitdaging.

We zullen er niet in slagen om de komende tsunami van digitale misleidingen voor te blijven, omdat we levende tegenstellingen zijn, de intelligente/stomme/rationele/emotionele soort. We volgen. We geloven voordat we denken. We verwarren kennis met wijsheid en vertrouwen met competentie. Tot op zekere hoogte gaan we allemaal door de knieën voor de misvattingen, angsten, fantasieën en irrationele grillen van ons eigen spookachtige onderbewustzijn.

Onvoorbereid

Hoewel we in staat zijn om de maan te bereiken en de interne werelden van atomen te verkennen, blijven we onvoorbereid als denkers, met geesten die te vaak niet opgewassen zijn tegen het tempo en de complexiteit van de moderne wereld die we hebben gemaakt.

De volwassen bevolking wemelt van de slaapwandelaars en aankomende slachtoffers, omdat de mensheid generatie na generatie verzuimt haar kinderen te leren hoe ze kritisch moeten denken. Onze standaardinstelling is om bijna alles te accepteren of te vertrouwen wat goed voelt, in een glimmende verpakking zit of wordt onderschreven door een autoriteitsfiguur. Onze meest absurde overtuigingen reizen de halve wereld al rond voordat ons kritisch denken wakker wordt en de eerste kop koffie kan inschenken. En nu stelt AI de ‘bad guys’ in staat om de dagelijkse plaag van oplichtingen, sociale verdeeldheid en waanzin aan te scherpen, te versterken en te versnellen, terwijl er ook talloze nieuwe variaties en toevoegingen worden geïntroduceerd.

Respecteer de blinde vlek van bias (Pronin et al. 2002). Niemand van ons zou ervan uit moeten gaan dat we te slim zijn om bedrogen te worden door wat komen gaat. De huidige kwaliteit van door AI gegenereerde misleidingen, bedrog, oplichting en fraude is formidabel, maar wat er op zeer korte termijn op ons afkomt is pas echt alarmerend. Bovendien moeten we dit alles plaatsen in de context van een misinformatie- en desinformatiecrisis die al in volle gang is. Oneindige aantallen video’s van een halve minuut hypnotiseren nu miljoenen mensen. Nieuws-feeds op sociale media ontmantelen al jaren samenlevingen en tasten democratieën aan. Onderzoekers hebben vastgesteld dat nepnieuws zich online zes keer sneller verspreidt dan echt nieuws (Vosoughi et al. 2018). Binnenkort zullen we misschien terugverlangen naar de al lang achter ons liggende tijd van charmante e-mails van Nigeriaanse prinsen met geschenken en de schilderachtige QAnon-gekte.

We kunnen niet weten of kunstmatige algemene intelligentie (AGI) deze eeuw, de volgende eeuw of ooit zal ontstaan of evolueren (Russell 2019, 4-11). AGI, een echte superintelligentie, zou lijken op de goddelijke entiteit die door veel sciencefictionschrijvers wordt gepopulariseerd. Het zou in staat zijn om zelfstandig te leren, problemen op te lossen en creatief te zijn, vaag vergelijkbaar met de capaciteiten van een menselijk brein, maar met immens veel meer snelheid en kracht. Maar of AGI er nu komt of niet, de recente vooruitgang kan genoeg zijn om ons te bedelven onder een paradigma-verschuivende lawine van deepfakes (hyperrealistische foto’s, spraaksimulaties en video’s). AI-tools die nu beschikbaar zijn, worden bijvoorbeeld steeds vaker gebruikt voor geraffineerde phishing-zwendel, het kraken van wachtwoorden, het klonen van telefoongesprekken, nepwebsites, CEO-zwendel, neppornografische video’s van echte mensen en nog veel meer (Henry 2023; Associated Press 2023; 2024).

Domme AI

Iedereen die twijfelt aan onze kwetsbaarheid hoeft alleen maar te kijken naar het onheilspellende voorproefje van sociale media. In de afgelopen twintig jaar hebben verschillende sociale mediabedrijven opmerkelijk succes geboekt met het identificeren, cultiveren en te gelde maken van de angst, vooroordelen, lust, liefde, woede en haat van hun gebruikers. En ze hebben dit bereikt met relatief domme algoritmen en beperkte AI-systemen (Harrison 2017). Helaas zijn er sterke aanwijzingen dat deze bedrijven eerder slechter dan beter worden in het beteugelen van de misinformatie en desinformatie die goed gedijen op hun platforms (Nix en Ellison 2023).

Voeg daarbij de stijgende trend van overheden en politici die AI gebruiken om de publieke opinie te manipuleren en online informatie te censureren (Funk et al. 2023). Tot slot werd in een enquête onder bijna 1.500 deskundigen wereldwijd AI-gegenereerde misinformatie en desinformatie genoemd als “het ernstigste mondiale risico dat de komende twee jaar wordt verwacht” (World Economic Forum 2024, 8).

Veel van de komende AI-impact zal ongetwijfeld nuttig en vermakelijk zijn, maar zal er later ook gerend en geschreeuwd worden? Als grotere AI-krachten in handen komen van onverantwoordelijke, onbekwame, onethische en criminele gebruikers, zijn de volgende scenario’s waarschijnlijk:

- Meer mensen geloven meer absurditeiten met meer stelligheid dan ooit tevoren.

- Steeds meer corrupte en/of incompetente politici worden gekozen voor hoge functies in democratieën.

- Het vertrouwen in wetenschap en expertise in het algemeen keldert. Demagogen en charlatans vullen de leegte.

- Dictators en totalitaire regeringen genieten van ongekend toezicht op en controle over hun bevolking.

- Medische kwakzalverij floreert waardoor wereldwijd het lijden toeneemt en de levensverwachting daalt.

- Theocratische leiders in religieuze fundamentalistische samenlevingen gebruiken AI om LGBTQ mensen, godslasteraars en ondergedoken ketters te identificeren voor vervolging en erger.

Mensen zullen lijden. Mensen zullen sterven. Laten we desondanks proberen iets positiefs in dit alles te vinden. Een ongekende wereldwijde catastrofe van fraude en waanvoorstellingen kan mogelijk de katalysator zijn die ons helpt onszelf naar een betere plek te tillen.

Cognitieve Upgrade

AI-trucage en onrust zouden onze soort kunnen dwingen tot een langverwachte cognitieve upgrade. We stellen ons meestal toekomstscenario’s voor waarin harde technologie de menselijke hersenen verbetert, een top-down proces met fysieke implantaten en interfaces. Maar het zou ook een organisch bottom-up fenomeen kunnen zijn, een transformatie aan de basis in de vorm van een collectieve afwijzing van blind vertrouwen en ongegrond geloof. Zeker een optimistische toekomstvisie, maar niet onmogelijk. Houd in gedachten dat de gereedschappen voor kritisch denken er altijd zijn, beschikbaar voor iedereen om op te pakken en te gebruiken. Ze vereisen geen buitengewone intelligentie, uitgebreide formele opleiding of grote private of publieke financiële investeringen. Goed denken is vooral een kwestie van bewustzijn en motivatie (Harrison 2015, 15-34).

Kritisch denken

Kritisch denken zou een nieuw cultureel universeel voor de mensheid kunnen worden, een kerncode die aan elk kind wordt geleerd en van elke volwassene wordt verwacht. Misschien is alles wat we nodig hebben een dramatische duw in de goede richting om kritische massa te bereiken en op een punt te komen waar genoeg mensen zich realiseren dat het dom is om dom te zijn. Mocht een door AI aangewakkerd wildvuur van psychologische chaos ertoe leiden dat we als soort een intellectueel dieptepunt bereiken, dan kunnen we alleen nog maar omhoog. Positieve aanpassing zou gezien kunnen worden als een no-brainer, zelfs door de hersenlozen. Second guessing zou een tweede natuur kunnen worden. Iedereen zou alles in vraag stellen en de trotse, agressieve, koppige dwaasheid die vandaag zo gewoon en ontmoedigend is, zou van de ene dag op de andere alle aantrekkingskracht verliezen. Voor het eerst in de geschiedenis zou de praktische toepassing van scepticisme, waardering voor wetenschap en de voorkeur voor op bewijs gebaseerde besluitvorming bij een meerderheid in zwang zijn.

Net als een pijnlijke maar levensreddende medische behandeling heeft onze wereld misschien wat AI-verwoesting en -vernietiging nodig om verandering teweeg te brengen. Niets anders heeft gewerkt en we kunnen het ons niet veroorloven om op evolutie te wachten. Met perfect gekalibreerde leugens en onweerstaanbare hoaxes die de hele tijd overal aanwezig zijn, zal het moeilijker dan ooit worden om “gewoon te geloven”.

Wie kan de vlakke-aarde-lijn blijven volgen wanneer een miljoen verschillende Oscarwaardige YouTube-video’s – stuk voor stuk ingesproken door de enthousiaste AI-gegenereerde stem van Neil deGrasse Tyson – beweren dat onze planeet wel degelijk de vorm van een donut heeft? Wat zullen toegewijde QAnon-strijders doen wanneer cognitieve dissonantie door hun hoofd giert in het kielzog van rolverwisselende deepfake-video’s waarop een troep kannibaalbaby’s te zien is die Tom Hanks en Oprah Winfrey achtervolgen? Zelfs de laatste UFO-fanaat, uitgeput door een oneindige stroom van perfecte AI-oplichtingen, zal breken: “Weet je, ik ben gewoon niet zeker over deze nieuwe UFO-video. Sorry, maar ik heb bevestiging nodig van verschillende geloofwaardige bronnen in combinatie met wetenschappelijk gecontroleerd bewijs.”

Stel je eens voor: foto’s van de ‘Grassy Knoll’ op Dealey Plaza, op Facebook, Instagram en TikTok, die stuk voor stuk een peloton door de tijd reizende diepstaat-moordenaars onthullen die het gemunt hebben op JFK. Wat is er leuk aan een samenzweringstheorie zonder mysterie? Als de Bigfoot-foto’s scherp en in kleur zijn, is de grote man niet meer zo fascinerend. Alex Jones, Russell Brand, Graham Hancock, Jeremy Corbell, Tucker Carlson en alle andere professionele goedgelovigheidsdraaikolken zullen overbodig worden. Wie heeft hun verzinsels nodig als een miljard amateurs AI kunnen gebruiken om alternatieve realiteiten te creëren die net zo goed of beter zijn dan alles wat zij kunnen verzinnen?

Wakker worden?

Er is geen manier om te weten of we het hemel- of het hel-scenario van AI zullen krijgen. Misschien geneest het echt kanker, lost het armoede op en vindt het een lamp uit die langer meegaat. Of misschien kan het bepalen dat Homo sapiens nutteloos bio-voer is en ons de uitgang wijzen. Maar misschien is de meest waarschijnlijke uitkomst wel een troebele mix van goed en slecht. Dat lijkt immers ons lot te zijn met de meeste dingen. Ervan uitgaande dat de landing zacht genoeg is om te overleven, laten we hopen dat onze problemen met AI in ieder geval de motivatie leveren die we nodig hebben om eindelijk wakker te worden, volwassen te worden en een rationelere soort te worden.

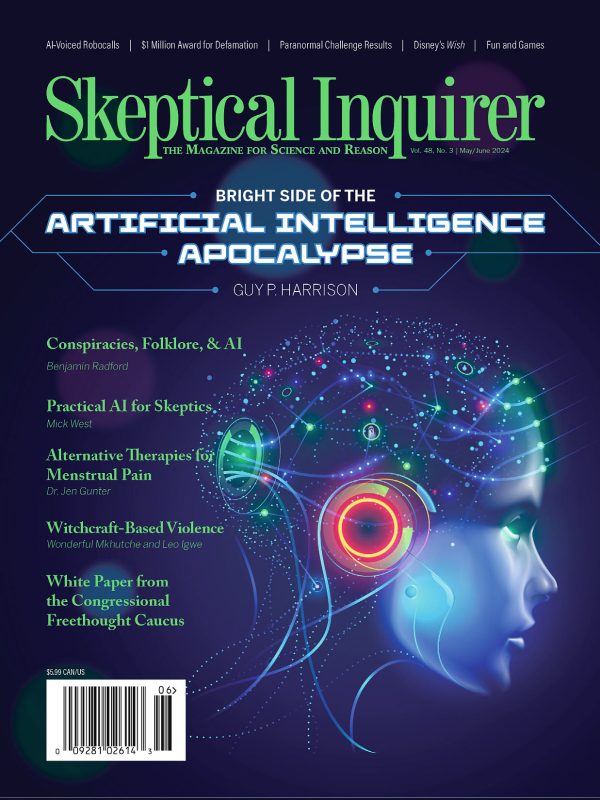

Dit artikel verscheen eerder in Skeptical Inquirer, Volume 48, no.3

Guy P. Harrison is een bekroond schrijver en auteur van negen boeken, waaronder Damn You, Entropy!, At Least Know This, en Good Thinking. Zijn werk is onder andere verschenen in Big Think, Reader’s Digest, Skeptical Inquirer, Free Inquiry en Skeptic. Guy schrijft al lange tijd essays voor Psychology Today en heeft een hoofdstuk over ras en racisme bijgedragen aan The Cognitive Science of Belief (Cambridge University Press). Random House publiceerde zijn boek Think: Why you should question everything als aanbevolen lectuur voor alle eerstejaars universiteitsstudenten.

Guy Harrison is de afsluitende Keynote-spreker op het Skepsiscongres, over AI, op 9 november a.s.

AI: een kwestie van gezond verstand?

Zijn nieuwste boek verschijnt begin augustus: